A placa aceleradora Mustang-F100 é baseada na FPGA Arria 10. Oferecendo alto desempenho para a sua aplicação IA na borda. Sendo uma escolha perfeita para cargas de trabalho de inferência de deep learning em IA.

Características:

– Eficiência energética, baixa latência. Kit de ferramentas OpenVINO ™ com suporte, dispositivo pronto para computação de ponta AI.

– FPGAs podem ser otimizados para diferentes tarefas de aprendizado profundo.

– Intel® FPGAs oferece suporte a vários pontos flutuantes e cargas de trabalho de inferência.

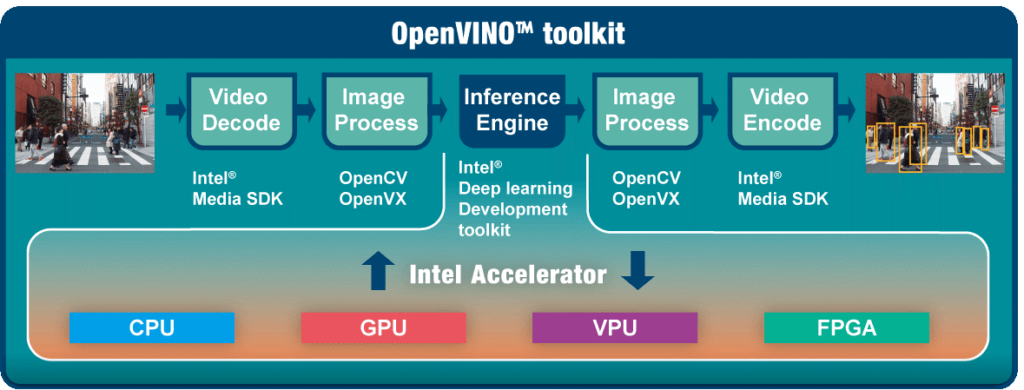

OpenVINO™ toolkit

O kit de ferramentas OpenVINO™ é baseado em redes neurais convolucionais (CNN – convolutional neural networks), o kit de ferramentas estende as cargas de trabalho em todo o hardware Intel® e maximiza o desempenho.

Ele pode otimizar o modelo de deep learning pré-treinado, como Caffe, MXNET, Tensorflow em arquivo binário IR e, em seguida, executar o mecanismo de inferência em hardware Intel® de forma heterogênea, como CPU, GPU, Intel® Movidius ™ Neural Compute Stick e FPGA.

Aplicações

Saiba mais em:

Servidor de alto desempenho para processar dados localmente

Avaliações

Não há avaliações ainda.